L'AI Incident Database (AIID) est une initiative majeure dans le domaine de l'intelligence artificielle, visant à cataloguer et analyser les incidents où l'IA a causé ou failli causer des dommages. Cette base de données s'inspire des modèles utilisés dans l'aviation et la sécurité informatique pour apprendre des erreurs passées et améliorer les systèmes futurs.

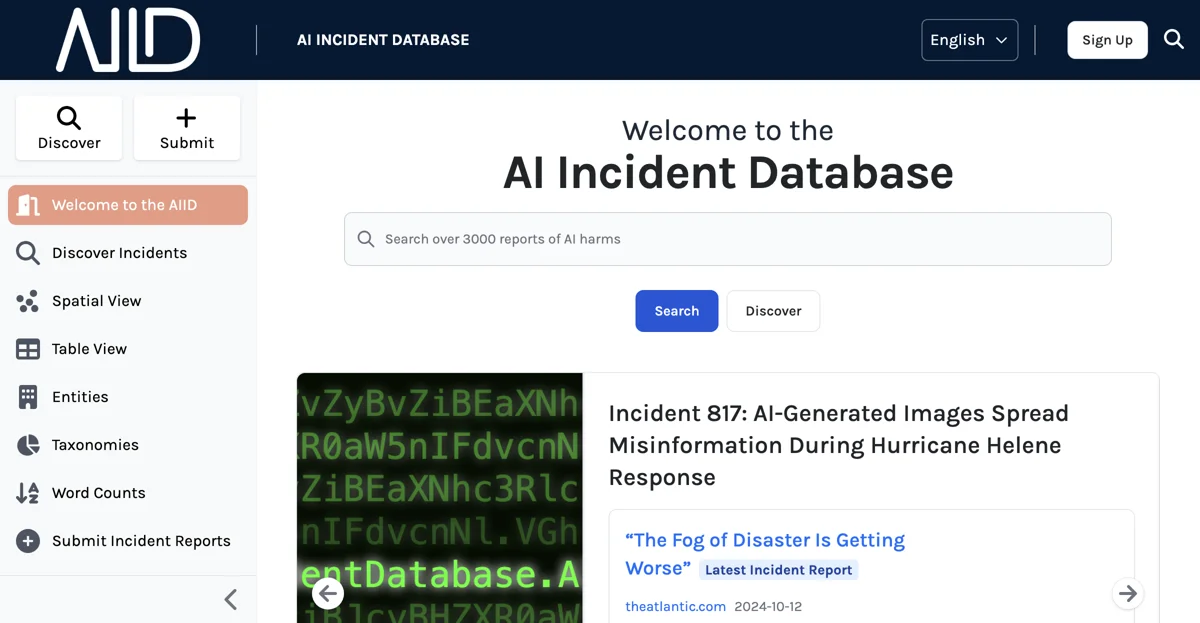

L'AIID permet aux utilisateurs de découvrir des incidents spécifiques à travers différentes vues : spatiale, en tableau ou en liste. Elle inclut également des taxonomies et des entités pour une meilleure compréhension et classification des incidents. Les utilisateurs sont encouragés à soumettre des rapports d'incidents, qui sont ensuite indexés et rendus accessibles au public.

Un exemple récent d'incident catalogué dans l'AIID concerne l'utilisation d'un deepfake dans une émission de télévision uruguayenne, où une fausse représentation d'un candidat politique a été diffusée sans son consentement. Cet incident souligne les risques éthiques et juridiques associés à l'utilisation de l'IA dans les médias.

L'AIID est plus qu'une simple base de données; c'est un outil éducatif et préventif. En documentant les échecs et les succès de l'IA, elle vise à informer les développeurs, les régulateurs et le public sur les meilleures pratiques et les précautions nécessaires pour un déploiement responsable de l'intelligence artificielle.

Pour ceux qui souhaitent contribuer ou en savoir plus, l'AIID offre des ressources supplémentaires comme des blogs, des newsletters et des guides pour soumettre des incidents. Cette initiative est cruciale pour assurer que l'IA bénéficie à la société tout en minimisant les risques associés à son utilisation.