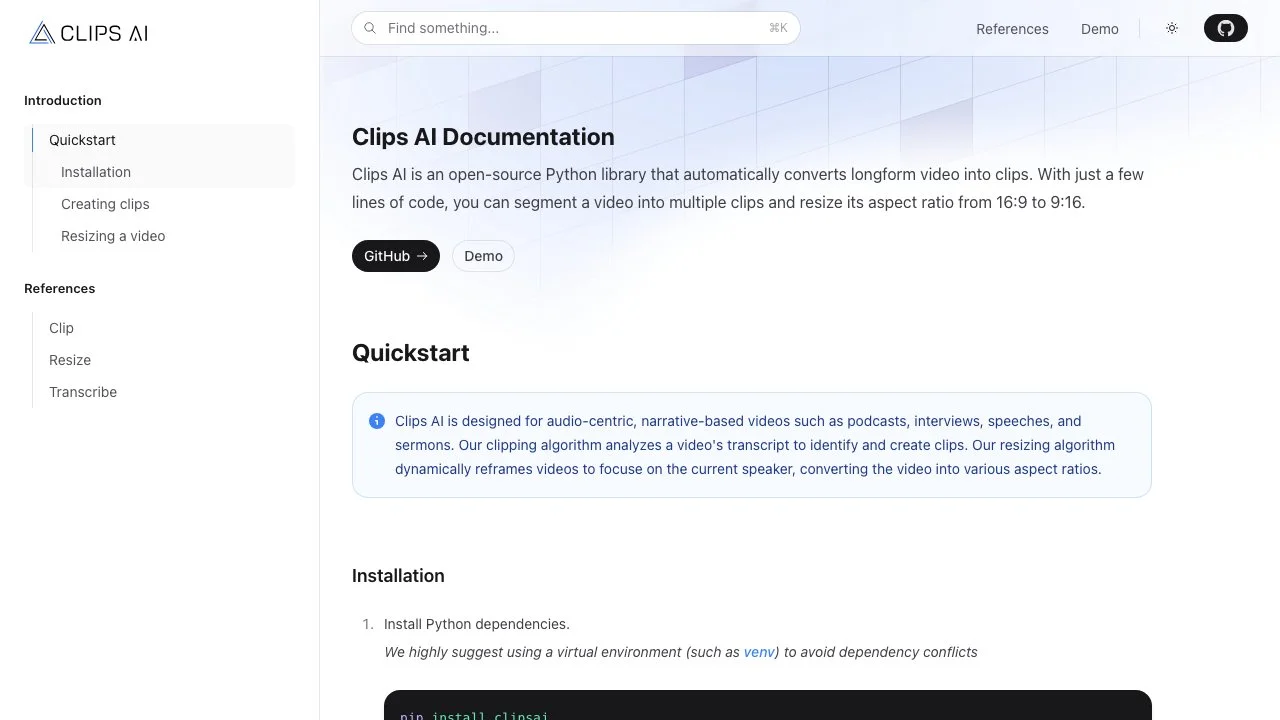

Clips AI : Le must-have pour les repurposages vidéo des développeurs

Clips AI, c'est la bibliothèque Python open-source qui déchire quand il s'agit de transformer les vids de long format en clips. Avec quelques lignes de code seulement, vous pouvez segmenter une vidéo en plusieurs clips et changer son ratio d'aspect de 16:9 à 9:16. C'est trop cool!

Conçue pour les vidéos axées sur l'audio et les récits, genre les podcasts, les interviews, les discours et les sermons, l'algorithme de clipping de Clips AI analyse le transcript de la vidéo pour dénicher et créer des clips. L'algorithme de redimensionnement, quant à lui, reframe dynamiquement les vidéos pour se focaliser sur l'orateur du moment, en convertissant la vidéo en différents ratios d'aspect. C'est fou, non?

Pour l'install, il faut installer les dépendances Python. On recommande vivement d'utiliser un environnement virtuel (comme venv) pour éviter les conflits de dépendances. On installe 'clipsai' et 'whisperx@git+'. Il faut aussi installer 'libmagic' et 'ffmpeg'.

Pour créer des clips, vu que les clips sont trouvés en utilisant le transcript de la vidéo, la vidéo doit d'abord être transcrite. La transcription se fait avec WhisperX, un wrapper open-source sur Whisper avec des fonctionnalités en plus pour détecter les temps de début et de fin de chaque mot. Pour couper la vidéo originale en un clip choisi, on se réfère à la référence de clipping.

Pour redimensionner une vidéo, un jeton d'accès Hugging Face est nécessaire car Pyannote est utilisé pour la diarisation des orateurs. Pas de souci, on ne sera pas facturé pour l'utilisation de Pyannote et les instructions sont sur la page Pyannote HuggingFace. Pour redimensionner la vidéo originale au ratio d'aspect souhaité, on se réfère à la référence de redimensionnement.