Parti: パスウェイズ自己回帰テキスト・ツー・イメージモデル

Partiは自己回帰テキスト・ツー・イメージ生成モデルで、高忠実度の写実的画像生成を達成し、複雑な構成と世界の知識を含む豊かな合成をサポートします。最近のテキスト・ツー・イメージ生成における拡散モデルの進歩、例えばGoogleのImagenも印象的な能力と研究ベンチマークでの最先端のパフォーマンスを示しています。PartiとImagenは、それぞれ自己回帰と拡散という2つの異なるジェネレーティブモデルの家族を探索することで互補的であり、これら2つの強力なモデルの組み合わせのためのエキサイティングな機会を開きます。

Partiはテキスト・ツー・イメージ生成を機械翻訳に類似したシーケンス・ツー・シーケンスモデリング問題として扱います。これにより、大規模言語モデルの進歩、特にデータとモデルのサイズを拡大することで解放される能力から恩恵を受けることができます。この場合、ターゲット出力は別の言語のテキストトークンではなく、画像トークンのシーケンスです。Partiは強力な画像トークン化器であるViT-VQGANを使用して画像を離散トークンのシーケンスとしてエンコードし、高品質で視覚的に多様な画像としてそのような画像トークンシーケンスを再構築する能力を活用しています。

以下の結果が観察されました。

- Partiのエンコーダー・デコーダーを200億パラメータまで拡大することで一貫した品質の向上が実現されました。

- MS-COCOにおいて最先端のゼロショットFIDスコア7.23と微調整FIDスコア3.22を達成しました。

- Localized NarrativesとPartiPrompts(この研究の一部としてリリースされる1600以上の英語プロンプトの新しい包括的ベンチマーク)における分析で、幅広いカテゴリと難易度の側面での有効性が示されました。

350Mから20Bパラメータへの拡大 PartiはLingvoで実装され、TPU v4ハードウェア上でGSPMDを使用して訓練と推論が行われ、20Bパラメータのモデルを訓練することができ、複数のベンチマークで記録的なパフォーマンスを達成しました。Partiモデルの4つのスケール(350M、750M、3B、20B)の詳細な比較を行い、以下のことが観察されました。

- モデルの能力と出力画像の品質の一貫したかつ実質的な改善。

- 3Bと20Bモデルを比較すると、人間の評価者は後者をほとんどの場合好んでいます。具体的には、画像の写実性/品質については63.2%、画像とテキストのマッチングについては75.9%です。

- 20Bモデルは特に抽象的で、世界の知識、特定の視点、または書き込みとシンボルの描画が必要なプロンプトで優れています。

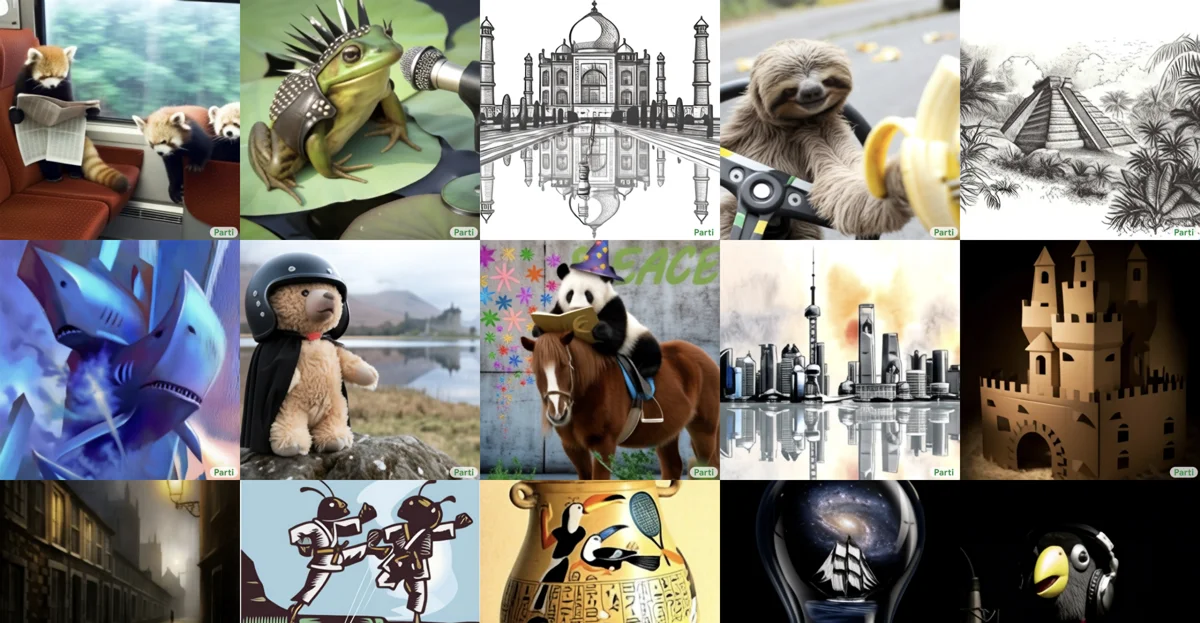

現実世界の知識を構成する テキスト・ツー・イメージ生成は、これまで見たことのないシーンを作成できるときに最も興味深いものです。Partiは長くて複雑なプロンプトを管理でき、世界の知識を正確に反映し、多くの参加者とオブジェクトを細かい詳細と相互作用で構成し、特定の画像フォーマットとスタイルに従うことができることが分かりました。

PartiPromptsベンチマーク PartiPrompts(P2)は、この研究の一部としてリリースされる1600以上の英語プロンプトの豊富なセットです。P2は様々なカテゴリとチャレンジの側面におけるモデルの能力を測定するために使用できます。

議論と制限 ここで示されている多くの画像は、プロンプトの探索と修正の相互作用中に生成された大量の例から選択(またはチェリーピック)されています。このプロセスを「チェリーツリーを育てる」と呼び、論文で詳細な例を提供しています。

Partiは幅広いプロンプトに対して高品質の出力を生成しますが、モデルには多くの制限があります。論文では、これらの課題を例と現在の失敗モード、および今後の研究の機会とともに議論しています。

責任とより広範な影響 テキスト・ツー・イメージモデルはバイアスと安全性、視覚的コミュニケーション、誤情報、創造性と芸術に潜在的な影響をもたらす多くの機会とリスクをもたらします。Imagenと同様に、Partiが有害なステレオタイプと表現をエンコードするリスクがあることを認識しています。

データカード Partiは複数のGoogle Researchチームの著者による共同作業です。

ギャラリー