Cleora AI 모델 요약

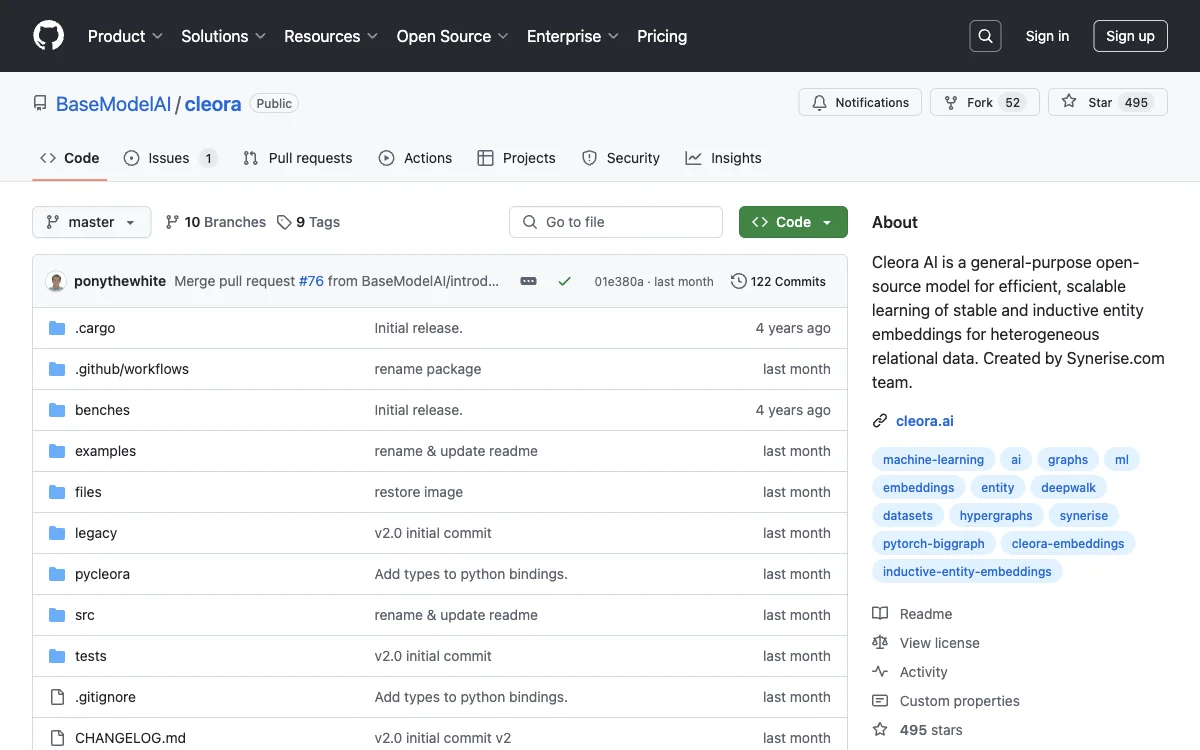

Cleora AI는 이질적인 관계형 데이터의 엔티티 임베딩을 학습하는 모델이다.

- 주요 특징: 임베딩 시간이 약 10배 빨라지고, 메모리 사용량이 줄어들며, 임베딩 품질이 향상된다.

- 새로운 기능: Python 이터레이터와 tsv 파일로 그래프 생성, NumPy와 통합, 사용자 정의 임베딩 초기화, 벡터 투영/정규화 조정 등.

- 사용 사례: 고객과 제품 데이터를 DataFrame으로 만들어 Cleora 입력 형식으로 변환하고, Markov 전환 행렬 생성, 임베딩 벡터 초기화 및 정규화하는 과정을 거친다.

- 성능 비교: DeepWalk보다 197배 이상 빠르고, PyTorch-BigGraph보다 4~8배 빠르다. 다른 AI 모델과 비교하면 다양한 데이터 유형과 형식에 적합한 다목적 도구로 효율성에서 차별화된다.

- 고급 팁: 1024부터 4096 사이의 임베딩 차원 사용을 권장하며, Markov 전파 반복 횟수에 따른 효과와 외부 정보로 임베딩 행렬 초기화 등이 있다. 전반적으로 이 모델은 이질적인 관계형 데이터의 엔티티 임베딩 학습에 유용하다.