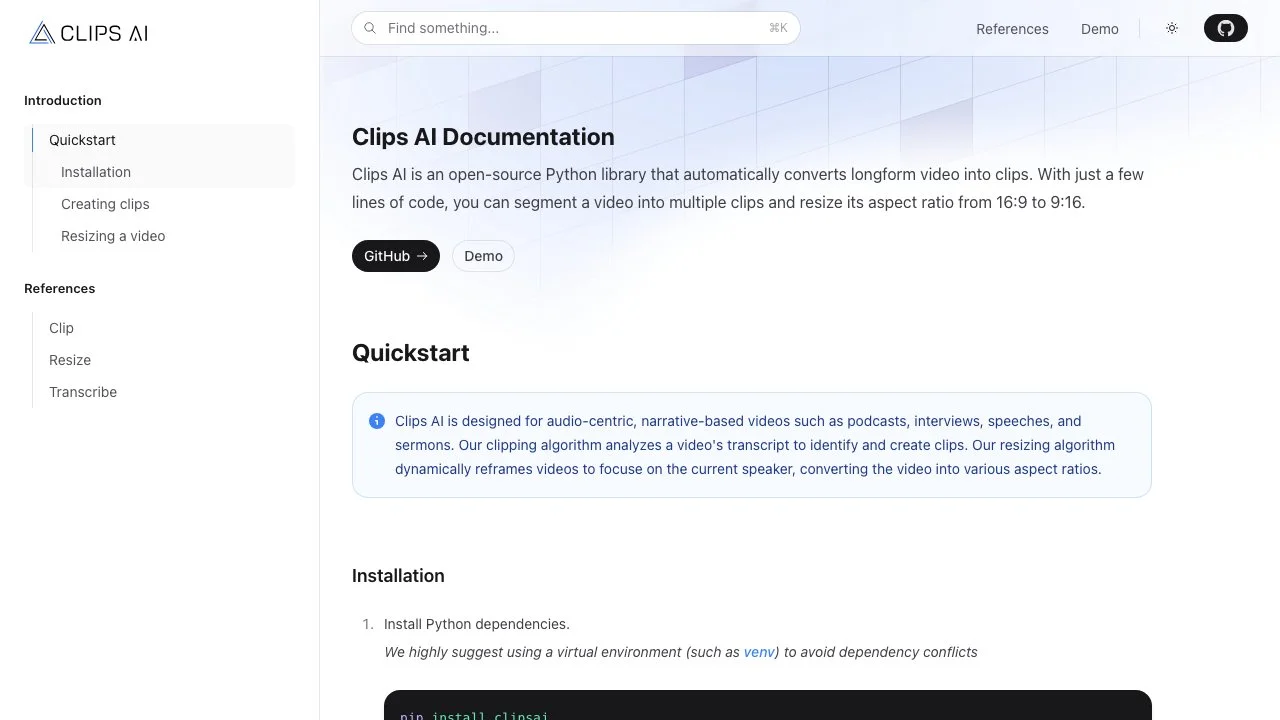

Clips AI: Uma Biblioteca Python para Reproposição de Vídeos

Clips AI é uma biblioteca Python de código aberto que traz uma solução inovadora para a transformação de vídeos longos em clipes. Com apenas algumas linhas de código, os usuários podem dividir um vídeo em múltiplos clipes e alterar a proporção de aspecto de 16:9 para 9:16.

Esta biblioteca é projetada especificamente para vídeos centrados em áudio e baseados em narrativas, como podcasts, entrevistas, discursos e sermões. O algoritmo de clipping analisa a transcrição do vídeo para identificar e criar os clipes. Além disso, o algoritmo de redimensionamento refaz dinamicamente os vídeos para focar no locutor atual, convertendo o vídeo em várias proporções de aspecto.

Para começar a trabalhar com o Clips AI, é necessário instalar as dependências do Python. É altamente recomendado utilizar um ambiente virtual (como o venv) para evitar conflitos de dependências. A instalação inclui o pacote clipsai e o whisperx, que é um invólucro de código aberto do Whisper com funcionalidades adicionais para detectar os tempos de início e fim de cada palavra.

Para criar os clipes, primeiro é preciso transcrever o vídeo. Isso é feito com o WhisperX. Depois, usando a classe ClipFinder, os clipes são encontrados com base na transcrição.

Para redimensionar um vídeo, é necessário um token de acesso do Hugging Face, pois o Pyannote é utilizado para a diarização do locutor. Não há cobrança pelo uso do Pyannote e as instruções estão na página do Pyannote no HuggingFace.

Em resumo, o Clips AI oferece uma ferramenta poderosa para desenvolvedores que desejam trabalhar com a reproposição de vídeos, permitindo uma maior flexibilidade e criatividade na manipulação de conteúdo audiovisual.