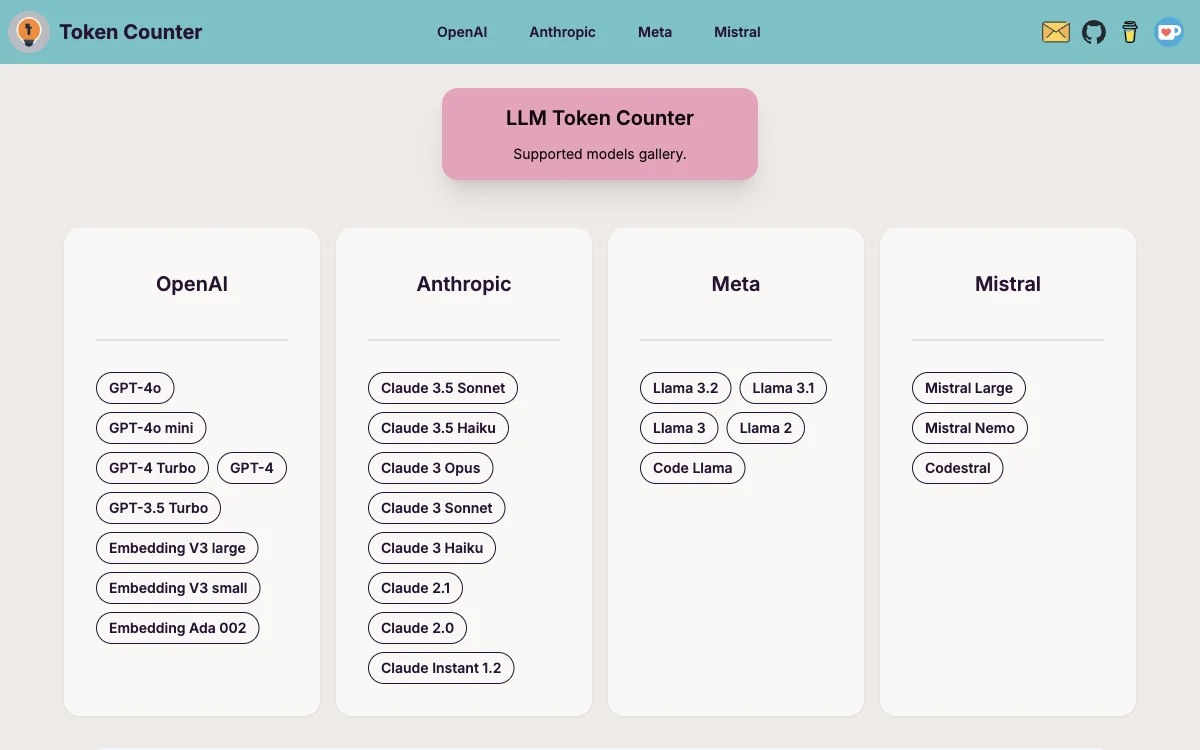

O LLM Token Counter é uma solução sofisticada projetada para auxiliar usuários no gerenciamento eficiente dos limites de tokens em uma ampla gama de Modelos de Linguagem (LLMs) amplamente utilizados, incluindo GPT-3.5, GPT-4, Claude-3, Llama-3, entre outros. Esta ferramenta é essencial para garantir que a contagem de tokens do seu prompt esteja dentro do limite especificado, evitando assim saídas inesperadas ou indesejadas do LLM.

A funcionalidade do LLM Token Counter é baseada no uso do Transformers.js, uma implementação em JavaScript da renomada biblioteca Hugging Face Transformers. Os tokenizadores são carregados diretamente no seu navegador, permitindo que o cálculo da contagem de tokens seja realizado no lado do cliente. Graças à eficiente implementação em Rust da biblioteca Transformers, o cálculo da contagem de tokens é extremamente rápido.

Uma das principais vantagens do LLM Token Counter é a garantia de privacidade dos seus dados. Como o cálculo da contagem de tokens é realizado no lado do cliente, seu prompt permanece seguro e confidencial, sem ser transmitido para o servidor ou qualquer entidade externa.

O compromisso com a expansão contínua dos modelos suportados e o aprimoramento das capacidades da ferramenta reflete o objetivo de proporcionar uma experiência ótima no uso da tecnologia de IA generativa. Para assistência ou sugestões de novas funcionalidades, os usuários podem entrar em contato via e-mail.

Além do LLM Token Counter, existem outras ferramentas de IA que podem ser de interesse, como o AI Math Solver para resolver problemas matemáticos complexos, o Stockwise para análise e insights do mercado de ações, e o Design0 para ferramentas de design criativo.