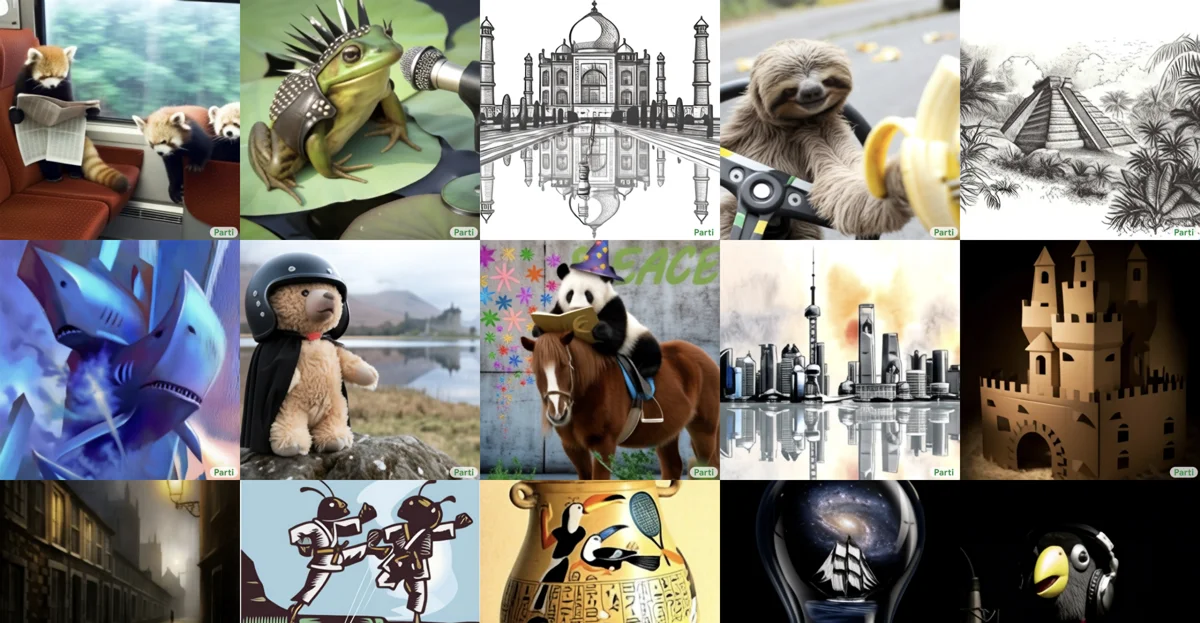

Parti:路径自回归文本到图像模型

Parti 路径自回归文本到图像模型是一种能够实现高保真逼真图像生成的自回归文本到图像生成模型,它支持涉及复杂构图和世界知识的内容丰富的合成。

近期,像谷歌的 Imagen 这样的基于扩散模型的文本到图像生成技术也展示出了令人印象深刻的能力和在研究基准上的最先进性能。Parti 和 Imagen 分别探索了两种不同的生成模型家族——自回归和扩散,为这两种强大模型的结合带来了令人兴奋的机会。

Parti 将文本到图像生成视为一个序列到序列的建模问题,类似于机器翻译。这使得它能够受益于大型语言模型的进步,特别是通过扩展数据和模型大小所释放的能力。在这种情况下,目标输出是图像标记的序列,而不是另一种语言的文本标记。

Parti 使用强大的图像标记器 ViT-VQGAN 将图像编码为离散标记的序列,并利用其能够将这样的图像标记序列重建为高质量、视觉多样化的图像的能力。我们观察到了以下结果:

通过将 Parti 的编码器 - 解码器扩展到 200 亿参数,实现了一致的质量改进。在 MS-COCO 上实现了最先进的零样本 FID 分数 7.23 和微调 FID 分数 3.22。在我们对 Localized Narratives 和 PartiPrompts(我们作为这项工作的一部分发布的包含 1600 多个英语提示的新整体基准)的分析中,在各种类别和难度方面都显示出了有效性。

我们还对从 3.5 亿到 200 亿参数的四种规模的 Parti 模型进行了详细的比较,并观察到:模型能力和输出图像质量的一致且实质性的改进。当比较 30 亿和 200 亿模型时,人类评估者在大多数时候更喜欢后者,特别是在图像真实性/质量方面为 63.2%,在图像 - 文本匹配方面为 75.9%。200 亿模型在抽象、需要世界知识、特定视角或书写和符号渲染的提示方面表现尤为出色。

PartiPrompts(P2)是我们作为这项工作的一部分发布的超过 1600 个英语提示的丰富集合。P2 可用于测量各种类别和挑战方面的模型能力。P2 提示可以很简单,允许我们衡量从扩展中取得的进展。它们也可以很复杂。

虽然 Parti 为广泛的提示产生高质量的输出,但该模型仍然存在许多限制。在论文中,我们通过示例讨论了这些挑战、当前的失败模式以及未来工作的机会。

文本到图像模型带来了许多机会和风险,对偏见和安全、视觉传达、虚假信息以及创造力和艺术都有潜在的影响。与 Imagen 类似,我们认识到 Parti 可能会编码有害的刻板印象和表现。一些潜在的风险与模型本身的开发方式有关,对于训练数据尤其如此。当前像 Parti 这样的模型是在大型、通常嘈杂的图像 - 文本数据集上进行训练的,这些数据集已知包含对不同背景的人的偏见。这导致这些模型,包括 Parti,产生对例如律师、空乘人员、家庭主妇等的刻板印象,并反映出西方对婚礼等事件的偏见。对于背景和兴趣在数据和模型中没有得到很好体现的人来说,这尤其会带来问题,特别是如果这些模型应用于视觉传达等用途,例如帮助低识字社会群体。产生逼真输出的模型,特别是人的模型,围绕深度伪造的创建带来了额外的风险和担忧。这在可能传播以视觉为导向的错误信息以及包含或参考其相似性的个人和实体方面产生了风险。

文本到图像模型为人们创造独特且美学上令人愉悦的图像开辟了许多新的可能性——本质上,它就像一支画笔,可以增强人类的创造力和生产力。然而,在评估设计或艺术价值时,重要的是要对多年来基于算法的艺术、模型本身、涉及的人员和更广泛的艺术环境有一个细致的理解。偏见在这里也很重要,因为模型的输出范围取决于训练数据,这可能对西方图像有偏见,并进一步阻止模型展示出全新的艺术风格——就像人类艺术家可以做到的那样。出于这些原因,我们决定在没有进一步的保障措施的情况下,不向公众发布我们的 Parti 模型、代码或数据。同时,我们在我们发布的所有图像上提供了 Parti 水印。我们将专注于通过进一步仔细的模型偏差测量和缓解策略,如提示过滤、输出过滤和模型重新校准,来跟进这项工作。我们相信,通过明确探测一系列已知的偏差类型,并可能发现其他形式的隐藏偏差,有可能使用文本到图像生成模型来大规模地理解大型图像 - 文本数据集中的偏差。我们还计划与艺术家协调,将高性能的文本到图像生成模型的能力适应到他们的工作中。