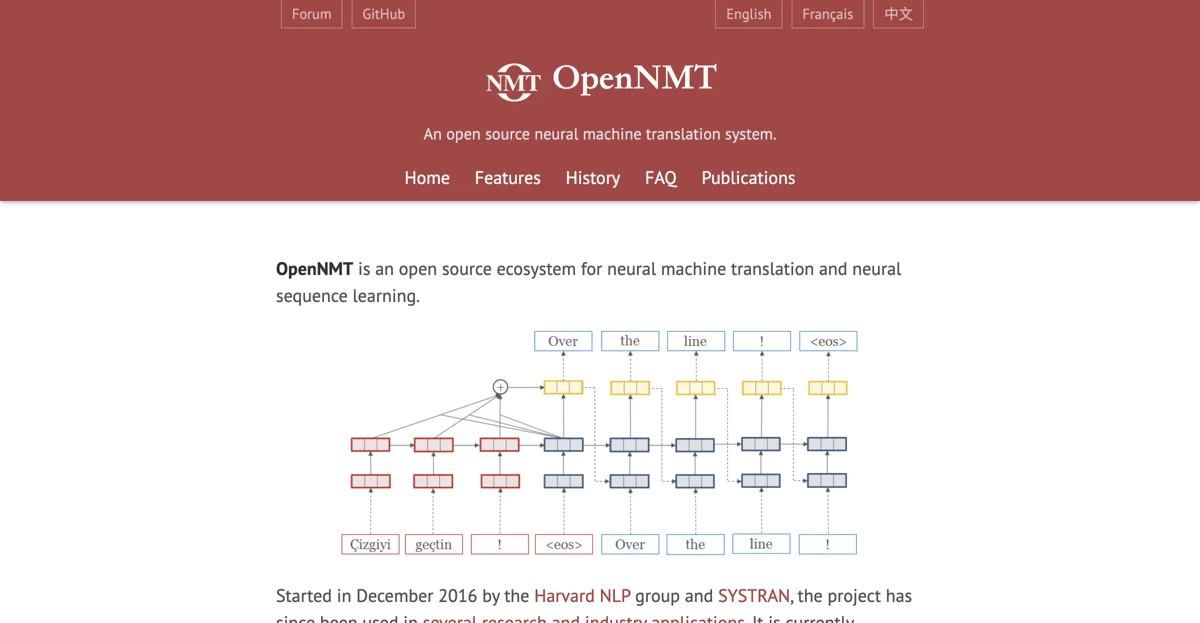

OpenNMT representa un avance significativo en el campo de la traducción automática neuronal, ofreciendo un ecosistema completo y de código abierto para la traducción y el aprendizaje de secuencias neuronales. Iniciado en diciembre de 2016 por el grupo Harvard NLP y SYSTRAN, este proyecto ha sido ampliamente utilizado tanto en investigaciones como en aplicaciones industriales. Actualmente, es mantenido por SYSTRAN y Ubiqus, asegurando su continua evolución y mejora.

El ecosistema OpenNMT se distingue por proporcionar implementaciones en dos de los frameworks de aprendizaje profundo más populares: OpenNMT-py y OpenNMT-tf. OpenNMT-py se caracteriza por su facilidad de uso y multimodalidad, aprovechando la simplicidad de PyTorch. Por otro lado, OpenNMT-tf ofrece modularidad y estabilidad, potenciado por el ecosistema TensorFlow. Ambas implementaciones comparten objetivos comunes, como arquitecturas de modelos altamente configurables, procedimientos de entrenamiento eficientes y capacidades de servicio de modelos para aplicaciones en el mundo real.

Además de las implementaciones principales, OpenNMT incluye proyectos complementarios que cubren todo el flujo de trabajo de la traducción automática neuronal. Entre estos, CTranslate2 destaca como un motor de inferencia eficiente para modelos Transformer en CPU y GPU, mientras que Tokenizer ofrece una biblioteca rápida y personalizable para la tokenización de texto, con soporte para BPE y SentencePiece.

Licenciado bajo la MIT License, OpenNMT no solo facilita el acceso a tecnologías avanzadas de traducción automática, sino que también fomenta la colaboración y la innovación en la comunidad de procesamiento de lenguaje natural. Con su enfoque en la configurabilidad, eficiencia y extensibilidad, OpenNMT se posiciona como una herramienta esencial para investigadores y desarrolladores que buscan avanzar en el campo de la traducción automática y más allá.