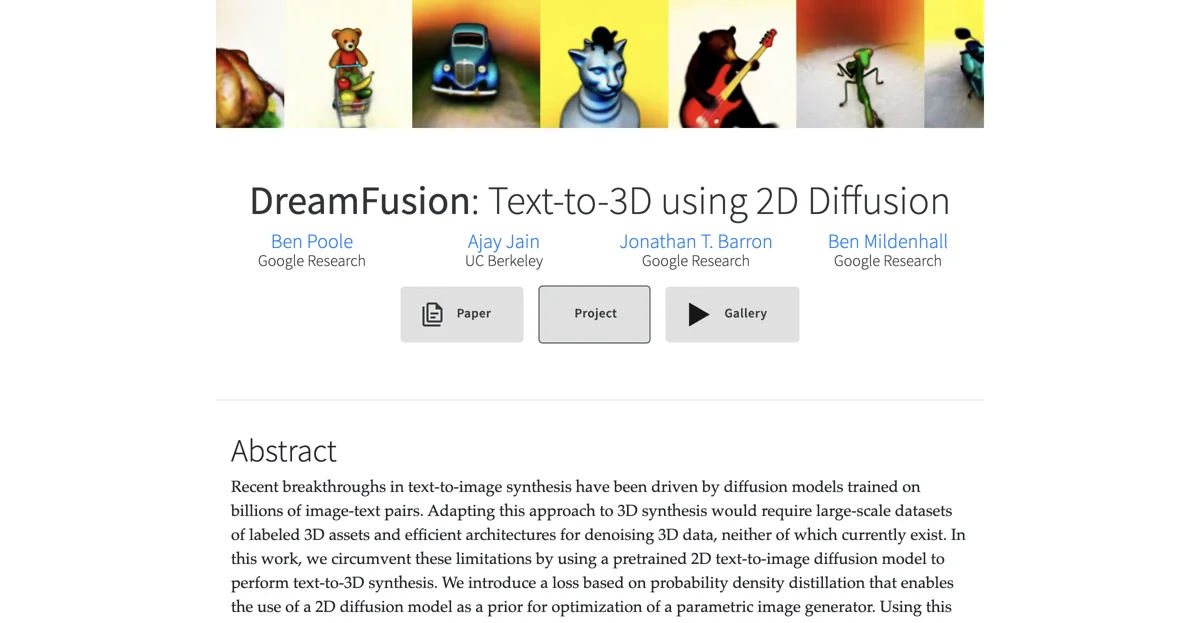

DreamFusion: Een coole AI-tool voor 3D-modellen vanuit tekst

DreamFusion maakt gebruik van een vooraf getraind 2D text-to-image diffusiemodel om text-to-3D-synthese mogelijk te maken. Dit is echt een game-changer, want het omzeilt de beperkingen die normaal gesproken bestaan bij het aanpassen van diffusiemodellen voor 3D. Geen grote datasets met gelabelde 3D-objecten nodig en ook geen ingewikkelde architecturen voor het ontstoffen van 3D-gegevens. Met DreamFusion kun je 3D-objecten met een topkwaliteit aan uiterlijk, diepte en normals maken, gewoon op basis van een gegeven omschrijving. Deze objecten worden gerepresenteerd als een Neural Radiance Field (NeRF) en maken gebruik van een vooraf getrainde text-to-image diffusieprior zoals Imagen. Bovendien kun je de gegenereerde NeRF-modellen naar meshes exporteren, zodat ze makkelijk te gebruiken zijn in 3D-renderers of modelleersoftware. Hoe werkt DreamFusion? Nou, het gebruikt een text-to-image generatief model zoals Imagen om een 3D-scène te optimaliseren. Daarnaast wordt er Score Distillation Sampling (SDS) gebruikt, een manier om samples te maken uit een diffusiemodel door een verliesfunctie te optimaliseren. SDS maakt het mogelijk om samples te optimaliseren in een willekeurige parametersruimte, zoals een 3D-ruimte, zolang we maar op een differentieerbare manier terug kunnen kaarten naar beelden. DreamFusion voegt ook nog eens extra regularisators en optimalisatiestrategieën toe om de geometrie te verbeteren. Hierdoor zijn de resulterende getrainde NeRF's supercoherent, met een hoge kwaliteit aan normals, oppervlaktgeometrie en diepte, en kunnen ze worden belicht met een Lambertiaanse schaduwwerkingmodel.