Thunder Compute 提供了一个革命性的云 GPU 解决方案,旨在简化和加速 AI 和 ML 模型的部署过程。通过其独特的技术,Thunder Compute 实现了 GPU 的网络附加,允许多个云实例共享一个 GPU 池,从而大幅提高了资源利用率和成本效益。

该平台的核心优势在于其快速设置、低成本和即时扩展能力。用户只需通过简单的 pip 安装命令即可访问 GPU,无需进行复杂的驱动配置。此外,Thunder Compute 提供了每月 20 美元的信用额度,用户只需为实际使用的计算资源付费,极大地降低了开发成本。

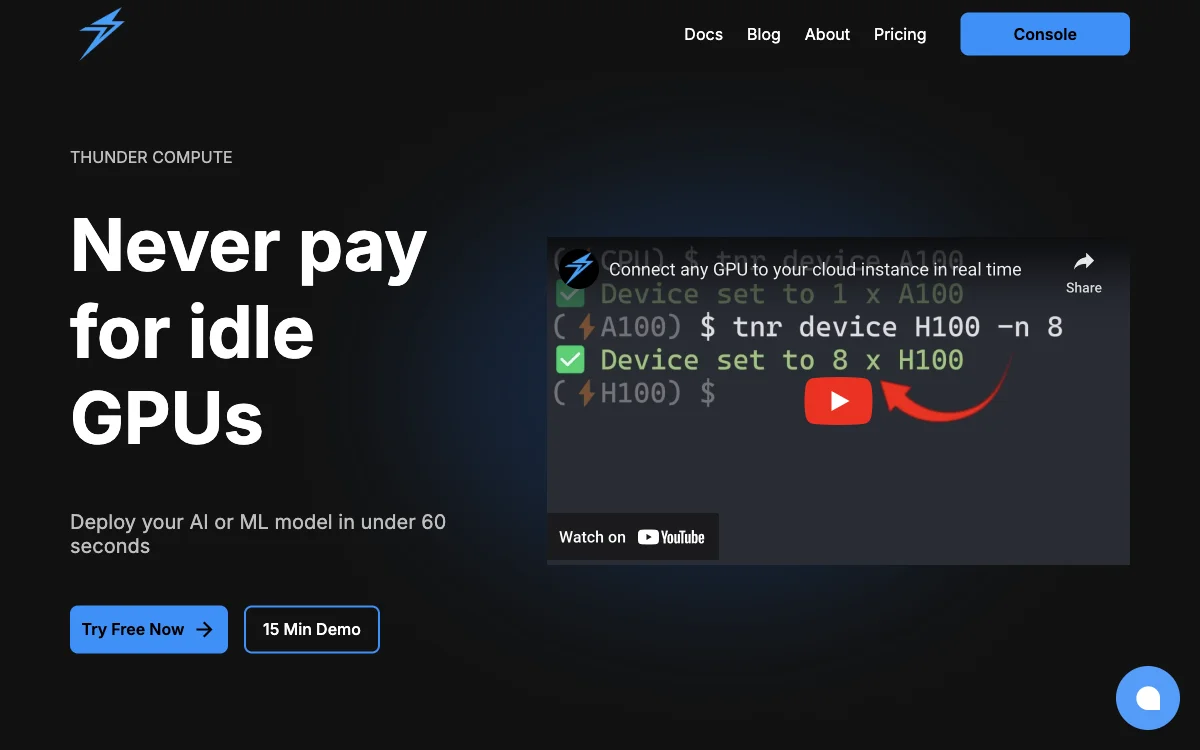

Thunder Compute 的即时扩展功能允许用户从原型开发无缝过渡到 GPU 集群,只需一个命令即可完成。这种灵活性使得 Thunder Compute 成为 AI 开发者的理想选择,无论是进行数据科学研究还是产品原型开发。

此外,Thunder Compute 的虚拟化技术不仅提高了 GPU 的使用效率,还简化了操作流程。用户可以在需要时连接到虚拟 GPU,并在不需要时断开连接,无需进行任何配置或驱动安装。这种便捷性使得开发者能够更加专注于他们的核心工作,而不是基础设施的管理。

Thunder Compute 的使命是通过提供更高效的 GPU 虚拟化技术,为 AI 和 ML 开发创造一个更好的体验。其技术不仅能够实现高达 5 倍的 GPU 利用率提升,还有助于节约环境资源和用户的成本。